ทุกวันนี้ เมื่อเลื่อนฟีดเฟซบุ๊กหรืออินสตาแกรม คุณอาจเจอ ‘คลิปวิดีโอคุณลุงแบกลูกช้างข้ามถนน’ ‘ละครคุณธรรมแมว’ หรือ ‘หน้าของบุคคลชื่อดังปรากฏในคลิปวิดีโอที่ถูกสร้างขึ้นเพื่อความบันเทิง’

สิ่งเหล่านี้คือตัวอย่างผลงานที่สร้างโดยเทคโนโลยีปัญญาประดิษฐ์ที่สามารถสร้างเนื้อหาใหม่ หรือ Generative-AI ที่ถูกใช้และแชร์อย่างแพร่หลายในสื่อโซเชียลมีเดีย ที่ในบางครั้งก็ทำเหมือนเสียจนแยกไม่ออกว่าชิ้นไหนเป็นของจริงหรือถูกสร้างขึ้น ทั้งนี้ เครื่องมือนี้ยังมีบทบาทและสร้างประโยชน์ในการทำงานด้วยเช่นกัน ตั้งแต่การตั้งต้นไอเดียจนไปถึงการรังสรรค์ผลงานตามที่ต้องการได้

ในขณะที่ AI มีบทบาทในชีวิตของเรามากขึ้นเรื่อย ๆ แต่ข้อบังคับหรือจริยธรรมในการใช้ AI ยังคงตามไม่ทันอย่างที่ควรจะเป็น เรายังคงเห็นกรณีการใช้ AI ในการสร้างข้อมูลที่เป็นเท็จหรือบิดเบือนข้อเท็จจริงอย่างต่อเนื่อง

เช่นเดียวกับกรณี ‘AI กับการเลือกตั้ง’ ที่ในมุมหนึ่ง เครื่องมือนี้สามารถส่งเสริมประสิทธิภาพของการเลือกตั้งได้ แต่ในทางกลับกัน งานศึกษาก็ยังพบว่าการใช้ AI โดยไร้การควบคุม ก็อาจนำไปสู่การเผยแพร่ข้อมูลเท็จและการบิดเบือนข้อมูลจริงในช่วงเลือกตั้ง ส่งผลให้ประชาชนขาดความเชื่อมั่นในเรื่องข้อมูล หรืออาจนำไปสู่การเลือกตั้งที่ผลลัพธ์ถูกชี้นำมากกว่ามาจากการตัดสินใจด้วยข้อมูลที่ถูกต้องและเป็นกลาง

นอกเหนือจากการขับเคลื่อนสังคมด้วยชุดข้อมูลเปิด พวกเราชาว WeVis ก็ยังสนใจในประเด็นเรื่องบทบาทของเทคโนโลยีกับการมีส่วนรวมของภาคประชาชน เมื่อ AI มีบทบาทอย่างกว้างขว้าง และได้ก้าวมาเป็นส่วนหนึ่งในเกมเลือกตั้ง เราควรวางกรอบ AI ต่อประเด็นการเลือกตั้งไว้อย่างไร ?

AI กับการเลือกตั้ง เพื่อนรักหรือเพื่อนร้าย ?

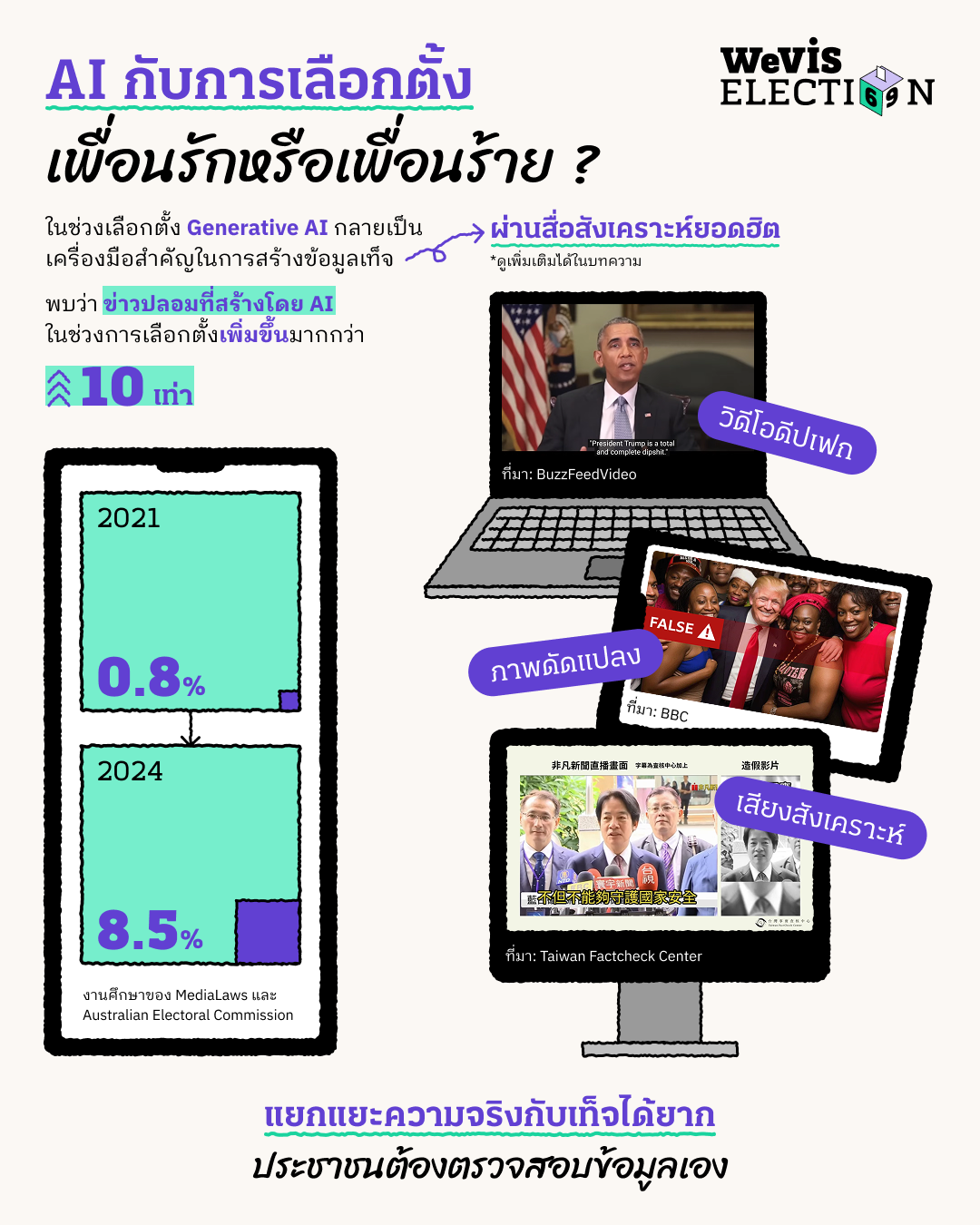

การปรากฎตัวของ AI ในเกมเลือกตั้ง อาจไม่ใช่ ‘เฟิสต์ อิมเพรสชัน’ อย่างที่เราคาดหวังกันไว้ แม้ AI จะเป็นเครื่องมือตั้งต้นที่ดีในการช่วยมนุษย์ทำงานด้านการสื่อสารข้อมูล เช่น การลดข้อจำกัดด้านความแตกต่างของภาษา โดยเฉพาะอย่างยิ่งในช่วงการหาเสียงเลือกตั้งของพรรคการเมืองต่าง ๆ ในประเทศที่มีการใช้ภาษามากกว่า 2 ภาษาขึ้นไป แต่งานศึกษาของ MediaLaws รวมถึง Australian Electoral Commission (AEC) หน่วยงานอิสระของรัฐบาลออสเตรเลียที่มีหน้าที่ดูจัดการการเลือกตั้งและประชามติ ต่างชี้ให้เห็นว่า Generative AI ได้กลายเป็นเครื่องมือสำคัญในการสร้างข้อมูลเท็จ โดยเฉพาะในช่วงที่มีการเลือกตั้งเกิดขึ้น

ปี 2024 ถือเป็นปีแห่งการเลือกตั้งครั้งใหญ่ครั้งหนึ่ง เพราะมีการเลือกตั้งระดับชาติเกิดขึ้นในกว่า 60 ประเทศ โดยรวมถึง 7 ประเทศที่มีจำนวนประชากรสูงสุดอย่าง บังกลาเทศ อินเดีย สหรัฐอเมริกา อินโดนีเซีย ปากีสถาน รัสเซีย เม็กซิโก และกลุ่มประเทศในสหภาพยุโรป และได้ปรากฏข้อมูลว่า พบข่าวปลอมที่สร้างโดย AI ในช่วงการเลือกตั้งเพิ่มขึ้นอย่างรวดเร็วจาก 0.78% ในปี 2021 เป็น 8.5% ภายในปี 2024

เทคโนโลยีนี้ถูกใช้เป็นอาวุธโดยตัวแสดงที่เกี่ยวข้องกับฝ่ายการเมืองในประเทศ และอาจเกี่ยวข้องกับตัวแสดงรัฐโดยตรงได้เช่นกัน เช่น เผยแพร่ข้อมูลที่เป็นเท็จต่อฝ่ายตรงข้ามเพื่อผลประโยชน์ทางการเมือง หรือเพื่อแทรกแซงการเลือกตั้งในต่างประเทศ โดยใช้ AI ผลิตสื่อสังเคราะห์หลายรูปแบบ ตัวอย่างเช่น

- วิดีโอดีปเฟก (Deepfake videos) ที่สร้างขึ้นเพื่อแสดงภาพบุคคลให้ทำหรือพูดในสิ่งที่ไม่ได้ทำจริง

ตัวอย่าง บารัค โอบามา กล่าวปราศรัยในเนื้อหาที่ไม่ได้พูดเอง (ที่มา BuzzFeedVideo)

- ภาพที่ถูกดัดแปลง คือภาพที่ถูกแก้ไขให้ดูสมจริงเพื่อทำให้เข้าใจผิด

ตัวอย่าง ภาพโดนัลด์ ทรัมป์ ประธานาธิบดี สหรัฐสวมกอดคนอเมริกันเชื้อสายแอฟริกา (ที่มา BBC)

- เสียงสังเคราะห์ เสียงบันทึกที่ถูกปลอมแปลงและเลียนแบบบุคคล โดยให้พูดในสิ่งที่ไม่ได้พูดจริง

ตัวอย่าง ดีปเฟกบิดเบือนคำพูดของ ไล่ ชิงเต๋อ ช่วงเลือกตั้งประธานาธิบดีไต้หวัน (ที่มา Taiwan Factcheck Center)

ผลที่ตามมาคือ ประชาชนไม่สามารถแยกแยะได้ว่าเนื้อหาที่เห็นหรือได้ยินในช่วงการหาเสียงเลือกตั้งนั้นเป็นเรื่องจริงหรือไม่ และกลับกลายเป็นว่าช่วงแรกนี้ การปรากฏตัวของ AI ในเกมเลือกตั้งได้เพิ่มภาระให้ประชาชนต้องเป็นผู้แยกแยะและตรวจสอบความถูกต้องของเนื้อหาด้วยตนเอง

รัฐรับมือกับ ‘การใช้ AI เป็นอาวุธทางการเมือง’ อย่างไร ?

ปัญหาเรื่องการใช้ AI เพื่อผลประโยชน์ทางการเมืองสามารถแก้ไขผ่านการวางระเบียบเรื่องการใช้งาน AI ในช่วงเลือกตั้ง และบทลงโทษทางกฎหมายหากมีผู้ละเมิด เพื่อกำกับดูแลการใช้เครื่องมือ AI ในด้านที่ควรจะเป็น คือใช้เพื่อการส่งเสริมการเลือกตั้งมากกว่าใช้เพื่อชี้นำการเลือกตั้ง

กรณีศึกษาแนวทางการกำกับดูแลการใช้เครื่องมือ AI ในการเลือกตั้งของสหรัฐอเมริกาและสหภาพยุโรป

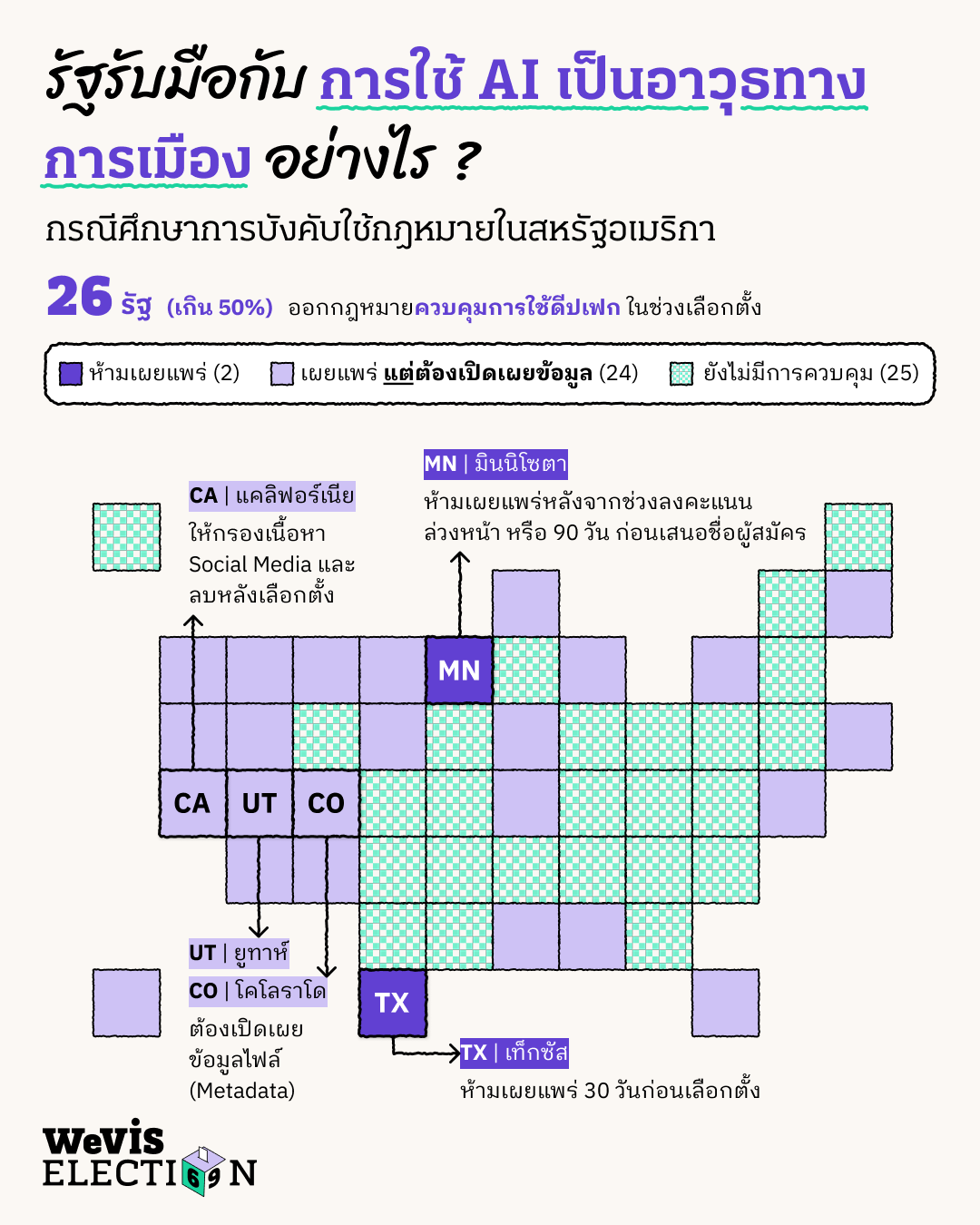

โดยทั่วไป สหรัฐอเมริกา จะมีสไตล์การกำกับดูแลเนื้อหาในโลกดิจิทัลในลักษณะ ‘แนวทางที่ไม่เน้นการควบคุม’ (Non-regulatory approach) คือให้ความสำคัญกับการคุ้มครองเสรีภาพในการแสดงออกตาม First Amendment หรือการแก้ไขรัฐธรรมนูญครั้งที่ 1 อย่างไรก็ดี การเกิดขึ้นของดีปเฟกในช่วงเลือกตั้งตั้งแต่ปี 2017 เป็นต้นมากลับทำให้ต้องกลับมาตั้งคำถามถึงวิธีการกำกับดูแลในลักษณะนี้ รวมถึงความจำเป็นในการมีกฎหมายเฉพาะที่ห้ามการใช้ AI มาทำลายความน่าเชื่อถือของการเลือกตั้งผ่านการสร้างคำปราศรัยปลอม ทำให้ตั้งแต่ปี 2019 จนถึง 2025 รัฐบาลท้องถิ่นของรัฐต่าง ๆ กว่า 26 รัฐได้เริ่มออกกฎหมายควบคุมการใช้ดีปเฟกในช่วงเลือกตั้งผ่าน 2 แนวทางหลัก คือ ‘การห้ามใช้’ และ ‘การกำหนดให้มีการเปิดเผยข้อมูล’

| แนวทางการควบคุม | รัฐที่ผ่านกฎหมาย | จำนวนรัฐ |

|---|---|---|

| ห้ามเผยแพร่ ดีปเฟกก่อนเลือกตั้ง | มินนิโซตา (หลังจากช่วงการลงคะแนนล่วงหน้า หรือ 90 วันก่อนวันเสนอชื่อผู้สมัคร) เท็กซัส (30 วันก่อนเลือกตั้ง) | 2 รัฐ |

| กำหนดให้มีการเปิดเผย ว่าสื่อนั้นเป็นดีปเฟกหรือไม่ | แอละแบมา แอริโซนา แคลิฟอร์เนีย โคโลราโด เดลาแวร์ฟลอริดา ฮาวาย ไอดาโฮ อินเดียนา เคนทักกี มิชิแกน มิสซิสซิปปี มอนตานา เนวาดา นิวเม็กซิโก นิวแฮมป์เชียร์ นิวยอร์ก นอร์ทดาโคตา ออเรกอน โรดไอแลนด์ เซาท์ดาโคตา ยูทาห์ วอชิงตัน วิสคอนซิน | 24 รัฐ |

ตัวอย่างเช่น

- รัฐมินนิโซตาและเท็กซัส ห้ามไม่ให้เผยแพร่ดีปเฟกทางการเมืองในช่วงจำนวนวันที่กำหนดก่อนการเลือกตั้ง

- 24 รัฐกำหนดให้ต้องมีข้อความเปิดเผยบนสื่อโดยต้องระบุว่าสื่อนั้นมีดีปเฟกหรือไม่

- รัฐโคโลราโดและยูทาห์กำหนดให้มีการเปิดเผยข้อมูลเพิ่มเติมใน Metadata เช่น ข้อมูลเกี่ยวกับผู้สร้างไฟล์ วันที่สร้างไฟล์ วันที่แก้ไขไฟล์

ทั้งนี้ กฎหมายท้องถิ่นอาจปรากฏความแตกต่างด้านถ้อยคำในตัวบทกฎหมายที่ทำให้การบังคับใช้จริงมีความหลากหลาย เช่น การใช้คำต่างกันอย่าง ดีปเฟก สื่อสังเคราะห์ หรือสื่อหลอกหลวง

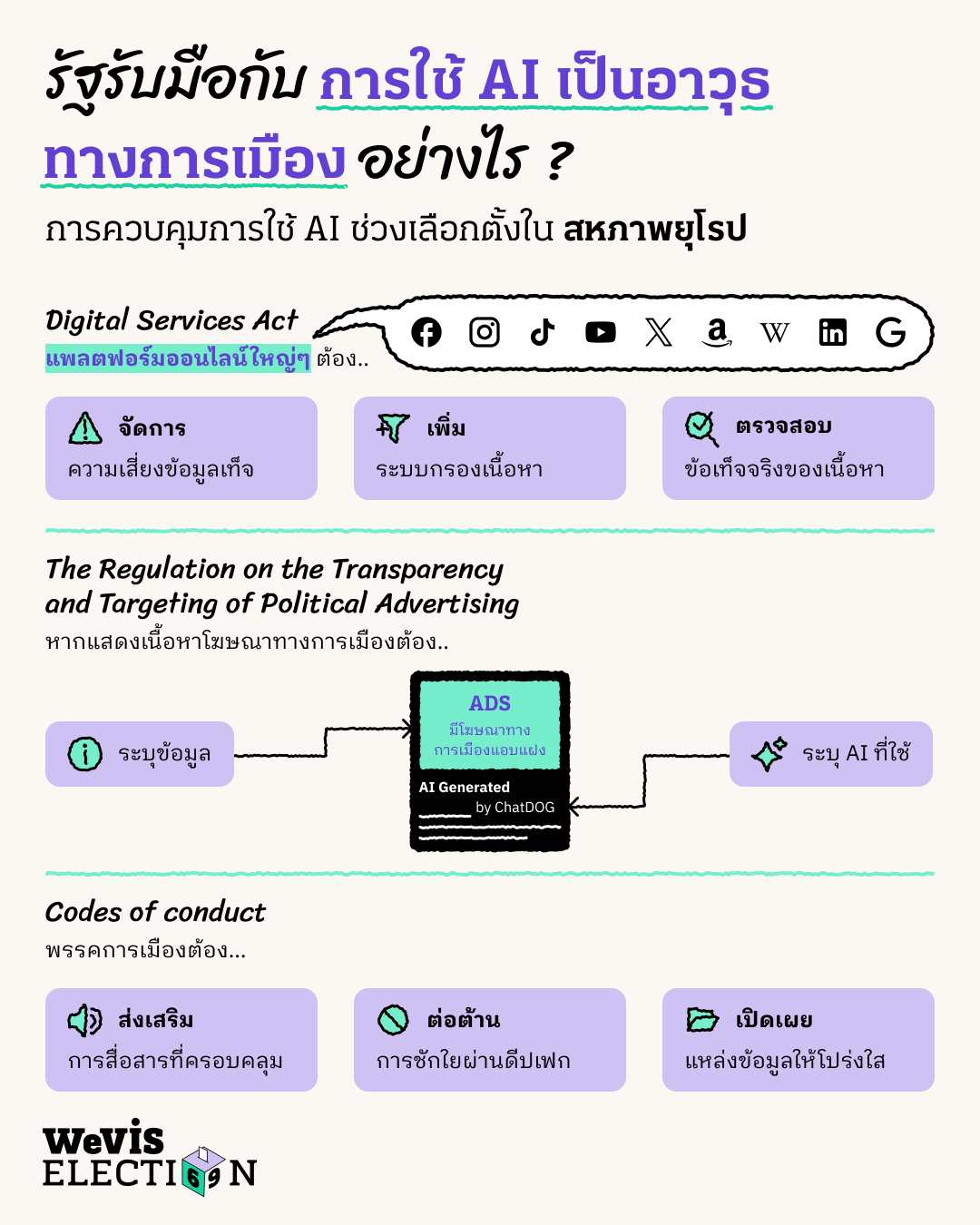

สหภาพยุโรป ใช้วิธีการจัดการปัญหานี้ด้วยการบังคับใช้กฎหมายเป็นการเฉพาะ ตัวอย่างเช่น

- Digital Services Act – DSA หรือ กฎหมายบริการดิจิทัล ที่กำหนดให้แพลตฟอร์มในกลุ่ม Very Large Online Platforms – VLOPs (แพลตฟอร์มออนไลน์ขนาดใหญ่) อย่าง Amazon, Facebook, Google, Instagram, LinkedIn, TikTok, X, Wikipedia, และ YouTube ระบุและจัดการความเสี่ยงที่อาจเกิดขึ้นในระหว่างการใช้งาน โดยเฉพาะระบบแนะนำเนื้อหาและระบบโฆษณาที่อาจแพร่กระจายข้อมูลเท็จให้ผู้ใช้งาน นอกจากนี้ VLOPs ยังต้องจัดทำการประเมินความเสี่ยงว่าการออกแบบแพลตฟอร์ม ฟีเจอร์ และอัลกอริทึมมีส่วนทำให้ข้อมูลเท็จแพร่กระจายอย่างไร โดยต้องพัฒนาและดำเนินมาตรการลดความเสี่ยง เพื่อเพิ่มความโปร่งใสของกระบวนการกลั่นกรองเนื้อหา หรือร่วมมือกับหน่วยงานรัฐและเอกชนอื่นเพื่อตรวจสอบข้อเท็จจริงของเนื้อหา แนวทางของกฎหมายบริการดิจิทัลได้สร้างกรอบความรับผิดชอบและกำกับการแพร่กระจายของข้อมูลเท็จที่ครอบคลุมทั้งในช่วงเลือกตั้งและนอกช่วงเลือกตั้งได้อย่างชัดเจน

- The Regulation on the transparency and targeting of political advertising หรือ กฎระเบียบว่าด้วยความโปร่งใสและการกำหนดเป้าหมายโฆษณาทางการเมือง เป็นระเบียบชิ้นใหม่ที่ถูกเขียนขึ้นหลังจากการอนุญาตให้ใช้เครื่องมือ AI ประมวลผลข้อมูลส่วนบุคคลเพื่อหาเสียงเลือกตั้งออนไลน์ ซึ่งมีข้อกังวลว่าแนวทางนี้อาจสร้างห้องสะท้อนเสียง (echo chambers) ที่จำกัดการเข้าถึงมุมมองที่หลากหลาย และอาจแพร่กระจายของข้อมูลเท็จที่สอดคล้องกับอคติเดิมที่ผู้ใช้งานมีอยู่แล้ว ระเบียบชิ้นนี้จึงกำหนดให้ผู้เผยแพร่เนื้อหาต้องระบุข้อมูลกำกับประกอบว่าเนื้อหาที่แสดงต่อผู้ใช้งานมีลักษณะเป็นโฆษณาทางการเมืองหรือไม่ และต้องอธิบายให้ผู้ใช้งานเข้าใจถึงเทคนิคและประเภทเครื่องมือ AI ที่ใช้ ระเบียบนี้จึงมีเป้าหมายเพื่อเพิ่มศักยภาพให้ผู้ใช้งานเข้าใจว่ามีการใช้ข้อมูลส่วนบุคคลของตนอย่างไร และเนื้อหาที่ได้รับมามีเป้าหมายทางการเมืองแอปแฝงอยู่ด้วยหรือไม่

นอกเหนือจากการบังคับใช้กฎหมาย สหภาพยุโรปยังใช้กลไกของคณะกรรมาธิการยุโรปในการกำกับสภาพแวดล้อมในช่วงเลือกตั้งให้โปร่งใสและยุติธรรม โดยตระหนักถึงบทบาทของ AI ในโลกออนไลน์และคุณภาพของข้อมูลที่ถูกเผยแพร่ในช่วงเลือกตั้ง ผ่านประมวลจริยธรรม (Codes of conduct) ที่เรียกร้องให้พรรคการเมืองและองค์กรทางการเมืองมีความรับผิดชอบและปกป้องคุณค่าประชาธิปไตย โดยครอบคลุมประเด็นสำคัญหลายประการ ได้แก่

- การส่งเสริมการสื่อสารที่ครอบคลุมทุกฝ่าย โดยสนับสนุนการถกเถียงอย่างสุภาพ และหลีกเลี่ยงวิธีการที่อาจสร้างความแตกแยกหรือกีดกันผู้มีสิทธิเลือกตั้งบางกลุ่ม

- การต่อต้านการชี้นำหรือชักใย ผ่านการเผยแพร่ข้อมูลเท็จ ดีปเฟก หรือเนื้อหาที่ทำให้เข้าใจผิดหรือสร้างความเกลียดชังเพื่อจูงใจผู้มีสิทธิเลือกตั้ง

- การเปิดเผยแหล่งที่มาเพื่อความโปร่งใสของข้อมูล เช่น ****ข้อมูลการบริจาคทรัพย์สิน เงินสนับสนุน รายจ่ายของการรณรงค์ การโฆษณาทางการเมือง

- ความมั่นคงปลอดภัยทางไซเบอร์ ช่น การตรวจสอบด้านความปลอดภัยไซเบอร์ เพื่อป้องกันการโจมตีที่อาจรบกวนการเลือกตั้ง

นอกเหนือจากการผลักดันของภาครัฐ ภาคเอกชนก็สามารถมีมีส่วนร่วมในการผลักดันการใช้ AI ในเกมเลือกตั้งอย่างสร้างสรรค์และต่อต้านการบิดเบือนข้อมูลในโลกออนไลน์ ตัวอย่างเช่น ในปี 2024 บริษัทเทคโนโลยีอย่าง Adobe, Amazon, Google, IBM, Meta, Microsoft, OpenAI, TikTok และ X ได้แสดงจุดยืนว่าจะบรรเทาความเสี่ยงที่เกิดจาก AI โดยให้ความสำคัญกับการตรวจจับ การจัดการ และความโปร่งใสของเนื้อหาในแพลตฟอร์มที่อาจทำให้เข้าใจผิด หรือความร่วมมือระหว่าง Meta และคณะกรรมาธิการยุโรปในการให้ข้อมูลแบบเรียลไทม์ระหว่างการเลือกตั้งรัฐสภายุโรป เป็นต้น

AI for good เกิดขึ้นได้จริงหรือไม่ ?

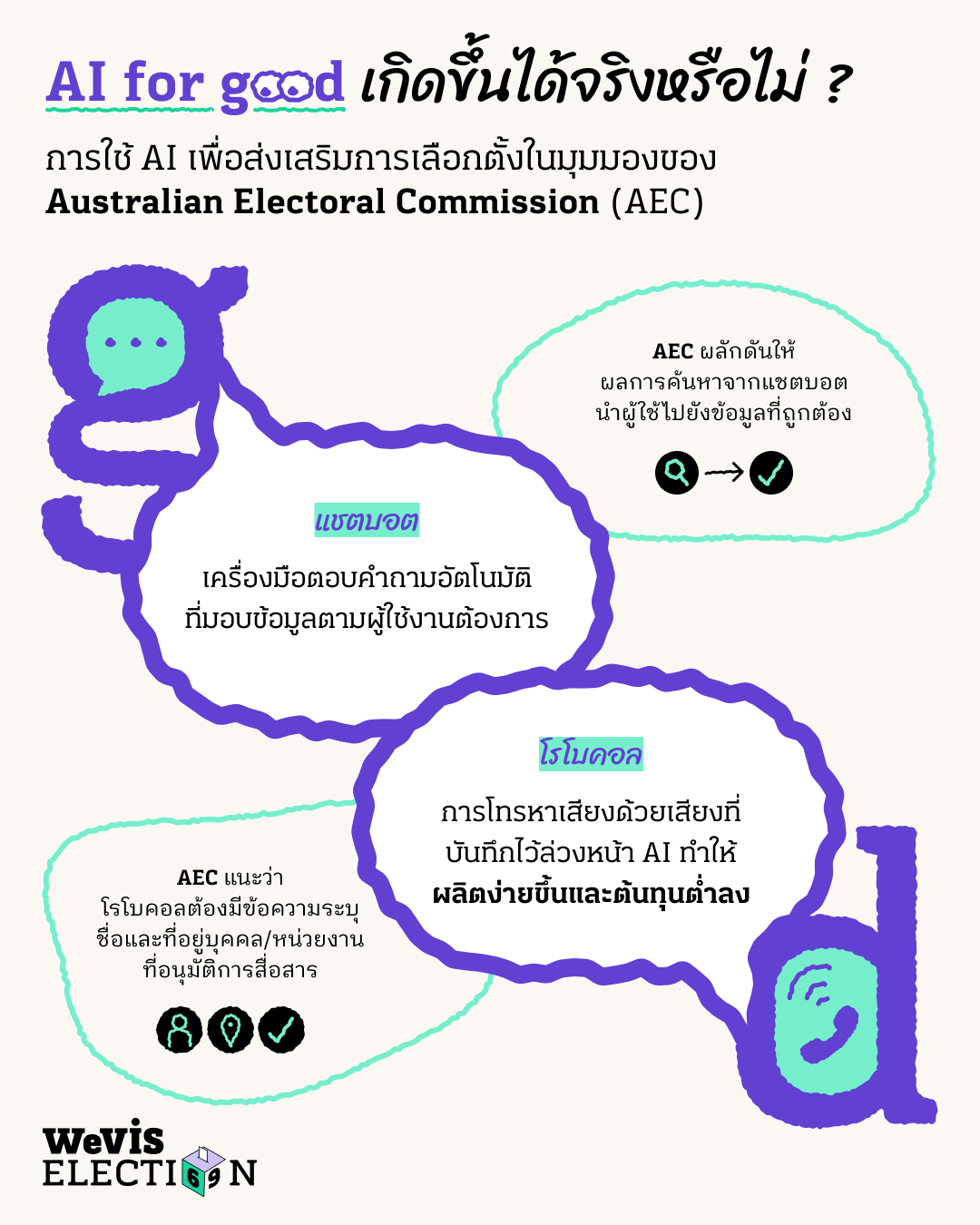

AI for good คือแนวคิดการใช้เทคโนโลยี AI อย่างมีจริยธรรม ท่ามกลางสังคมที่ใช้ Generative AI สร้างข้อมูลเท็จ Australian Electoral Commission (AEC) เสนอมุมมองเรื่องการปรับใช้เครื่องมือ AI เพื่อส่งเสริมการมีส่วนร่วมของผู้มีสิทธิเลือกตั้ง

ในมุมมองของ AEC การเลือกตั้งหนึ่งครั้งต้องใช้ทรัพยากรจำนวนมาก เช่น งบประมาณ เวลา และคนทำงาน ด้วยทรัพยากรที่มีอยู่อย่างจำกัดนี้ AI เปิดโอกาสให้ผู้ที่ทำงานในด้านนี้สื่อสารกับผู้มีสิทธิเลือกตั้งได้กว้างขึ้นและสะดวกกว่าที่เคยเป็น โดยไม่จำกัดเฉพาะแค่ผู้สมัครหรือพรรคการเมือง แต่ยังรวมถึงหน่วยงานรัฐที่มีหน้าที่ส่งเสริมการเลือกตั้ง และกลุ่มสื่อมวลชนและภาคประชาสังคมที่ผลักดันวาระการเลือกตั้งด้วยเช่นกัน

AEC ยกตัวอย่างการใช้เครื่องมือ Generative AI ในการจัดทำสื่อความรู้เรื่องการเลือกตั้ง ทำให้ผู้มีสิทธิเลือกตั้งเข้าถึงข้อมูลได้มากขึ้น และการใช้ปรับใช้ AI ที่ช่วยให้ผู้สมัครที่มีทรัพยากรน้อยสามารถสื่อสารกับผู้มีสิทธิเลือกตั้งได้กว้างขวางขึ้น ผ่านตัวอย่างการใช้แชตบอต (Chatbots) และโรโบคอล (Robocalls)

- แชตบอต คือเครื่องมือตอบคำถามอัตโนมัติที่มีความพร้อมในการตอบสนองอย่างรวดเร็วและมอบข้อมูลตามที่ผู้ใช้งานต้องการได้อย่างแม่นยำ ในปัจจุบัน เครื่องมือ Generative AI สามารถพัฒนาแชตบอตให้ใช้ภาษาที่ฟังดูเป็นธรรมชาติและรองรับการสนทนาด้วยเสียงได้ อีกทั้งเทคโนโลยี LLMs (Large Language Models) ในปัจจุบันก็ยังพัฒนาประสิทธิภาพในการแปลเนื้อหาข้ามภาษาได้เป็นอย่างดี อย่างไรก็ตาม แชตบอตก็มีประวัติเกี่ยวกับการสร้างข้อมูลเท็จ ซึ่งอาจให้ข้อมูลที่คลาดเคลื่อนได้ AEC ที่ตรวจพบว่ามีการใช้แชตบอตในการสื่อสารเนื้อหาการเลือกตั้ง จึงได้ตรวจสอบผลลัพธ์ของแชตบอตเพื่อประสานงานกับบริษัทที่เกี่ยวข้องในการผลักดันให้ผลการค้นหาจากแชตบอตนำผู้ใช้ไปยังเว็บไซต์ของ AEC เพื่อเข้าถึงข้อมูลที่ถูกต้อง

- โรโบคอล หรือการโทรศัพท์หาเสียงแบบอัตโนมัติ คือการรณรงค์ที่ผู้มีสิทธิเลือกตั้งได้รับสายโทรศัพท์ซึ่งมีข้อความหาเสียงแบบบันทึกล่วงหน้า โรโบคอลไม่ใช่รูปแบบใหม่ในการเลือกตั้งของออสเตรเลีย การพัฒนาและประยุกต์ใช้ AI ทำให้การผลิตโรโบคอลทำได้ง่ายและมีต้นทุนต่ำลง เทคโนโลยี AI สามารถใช้สร้างเสียงพูดที่มีความคล้ายคลึงกับเสียงมนุษย์จริง แต่ก็มีข้อควรระวังเมื่อมีการจำลองเสียงของบุคคลใดบุคคลหนึ่งเพราะอาจเข้าข่ายดีปเฟกได้ AEC ระบุว่าการใช้โรโบคอลต้องมีข้อความระบุผู้อนุญาตในช่วงเริ่มต้นของการโทร ข้อความดังกล่าวต้องประกอบด้วยชื่อของบุคคลหรือหน่วยงานที่อนุมัติการสื่อสาร รวมถึงที่อยู่ของบุคคลหรือหน่วยงานนั้น

‘เมื่อ AI เปลี่ยนเกมเลือกตั้ง’ เราควรต้องรับมืออย่างไร ?

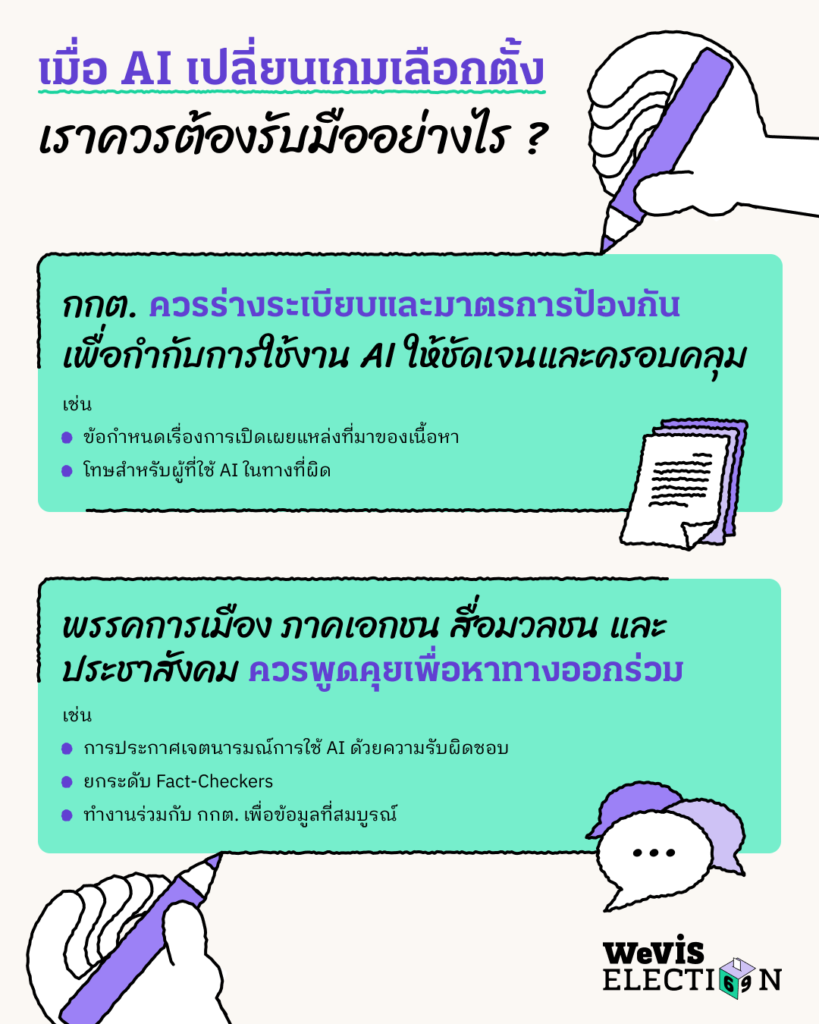

แม้ว่าการรับมือกับปัญหาการนำ AI มาใช้ในทางที่ไม่เหมาะสมในการเลือกตั้งควรเป็นภารกิจหลักของคณะกรรมการการเลือกตั้ง (กกต.) ซึ่งมีหน้าที่กำหนดระเบียบและกำกับดูแลการจัดการเลือกตั้ง ตลอดจนหน่วยงานของรัฐที่เกี่ยวข้อง อย่างไรก็ตาม ในระดับเชิงโครงสร้าง การจัดการปัญหานี้จะมีประสิทธิภาพมากยิ่งขึ้น หากผู้มีส่วนได้ส่วนเสียภาคส่วนอื่น ๆ ตระหนักถึงความสำคัญของประเด็นนี้และมีส่วนร่วมในการขับเคลื่อนมาตรการรับมือไปพร้อมกัน เช่น พรรคการเมือง ภาคเอกชน เช่น บริษัทเทคโนโลยีขนาดใหญ่ในไทย สื่อมวลชน ภาคประชาสังคม และประชาชนทั่วไป

ในปัจจุบัน กกต. ยังไม่มีข้อกำหนดเรื่องระเบียบการใช้ AI ในการเลือกตั้งอย่างชัดเจน อ้างอิงจากที่ผู้แทน กกต. ได้ชี้แจงต่อคณะกรรมาธิการการพัฒนาการเมือง การสื่อสารมวลชน และการมีส่วนร่วมของประชาชน (กมธ. พัฒนาการเมืองฯ) เมื่อวันพุธที่ 22 ตุลาคม 2568 ว่า กกต. กำลังพิจารณาทบทวนระเบียบที่เกี่ยวข้องกับการใช้ AI ในการหาเสียงเพื่อให้สอดรับกับบริบทสังคมในปัจจุบัน แต่ยังคงครอบคลุมการนิยามการใช้ AI ว่าเป็นประเภทสื่ออิเล็กทรอนิกส์ การหาเสียงโดยใช้ AI จึงเข้าข่ายการหาเสียงในรูปแบบดิจิทัล โดยกำหนดให้พรรคการเมืองแจ้งวิธีการ รายละเอียด ช่องทาง ระยะเวลาในการหาเสียงและหลักฐานอื่นตามที่กำหนดให้ผู้อำนวยการ กกต. ประจำจังหวัดทราบก่อนหาเสียงในรูปแบบดิจิทัล

จากตัวอย่างปัญหา ‘การใช้ AI เป็นอาวุธทางการเมือง’ ที่เกิดขึ้นในบริบทการเลือกตั้งของต่างประเทศ กกต. ควรริเริ่มการร่างกฎระเบียบและมาตรการป้องกัน เพื่อกำกับการใช้งาน AI ให้สอดคล้องกับการเลือกตั้งอย่างมีธรรมาภิบาลและโปร่งใส ให้สมกับการที่ กกต. ได้รับรางวัลต้นแบบองค์กรคุณธรรม โดย กกต. ต้องระบุเงื่อนไขการใช้ AI ในการเลือกตั้งให้ครอบคลุมกับทุกกลุ่มที่มีผลได้เสีย ตั้งแต่ภาคประชาชน ภาคเอกชน พรรคการเมือง และหน่วยงานรัฐ เช่น ระเบียบการใช้ AI ในการหาเสียง ระเบียบการใช้เนื้อหาหรือสื่อที่สังเคราะห์โดย AI ข้อกำหนดเรื่องการเปิดเผยแหล่งที่มาของเนื้อหาที่เผยแพร่ และการกำหนดโทษสำหรับผู้ที่ฝ่าฝืนหรือใช้ AI ในทางที่ผิด

ในส่วนของบทบาทของพรรคการเมือง ภาคเอกชน สื่อมวลชน และประชาสังคม กลุ่มผู้มีส่วนได้เสียเหล่านี้ควรส่งเสริมการใช้ AI ในการเลือกตั้งอย่างรับผิดชอบ โดยสามารถริเริ่มจากการพูดคุยเพื่อหาทางออกร่วมกัน ความพยายามนี้ได้ริเริ่มไปแล้วบ้าง เช่น การประชุมโต๊ะกลมในหัวข้อ “แนวทางการตรวจสอบข้อเท็จจริงเพื่อการเลือกตั้ง 2026 ที่เป็นธรรมบนหลักการ Fact Free Fair” ซึ่งจัดขึ้นโดยความร่วมมือของ กมธ. พัฒนาการเมืองฯ, โคแฟค (ประเทศไทย), และมูลนิธิฟรีดริช เนามัน เพื่อเสรีภาพ ในวันที่ 27 พฤศจิกายน พ.ศ. 2568 โดยสาระสำคัญของการประชุม ประกอบด้วย

- การกำกับดูแลการใช้ AI ผ่านการจัดทำมาตรการขอความร่วมมือโดยย้ำพรรคการเมืองให้ระบุโดยชัดแจ้งว่าเนื้อหาที่เผยแพร่นั้นผลิตด้วย AI หรือไม่และเสนอให้มีการเชิญพรรคการเมืองลงนาม *‘*Code of conduct’ หรือประกาศเจตนารมณ์ในการใช้ AI ด้วยความรับผิดชอบ เพื่อสร้างบรรทัดฐานที่ยอมรับร่วมกัน

- การยกระดับองค์กรตรวจสอบข้อเท็จจริง (Fact-Checkers) โดยแนะนำให้เป็นหน้าที่ขององค์กรอิสระ อย่าง NGOs หรือสื่อมวลชนมากกว่าหน่วยงานรัฐ เพื่อรักษาความเป็นกลางและความน่าเชื่อถือ และเสนอให้มีการจัดตั้งทีมและกรอบการทำงานตรวจสอบข่าวปลอมที่มีระบบและมาตรฐานชัดเจนโดยเฉพาะในช่วงเลือกตั้ง รวมถึงกระบวนการเผยแพร่ผลการตรวจสอบอย่างรวดเร็ว

- การทำงานร่วมกับ กกต. เพื่อรักษาความสมบูรณ์ของข้อมูล

การรับมือกับผลกระทบจากการใช้ AI ในเกมเลือกตั้งจึงจำเป็นต้องอาศัยความร่วมมือจากทุกภาคส่วน ไม่ใช่เฉพาะภาครัฐเท่านั้น การร่วมกันกำหนดแนวทางการใช้ AI อย่างรับผิดชอบ ควบคู่กับระบบตรวจสอบข้อเท็จจริงที่น่าเชื่อถือและการทำงานร่วมกับ กกต. จะช่วยรักษาความเป็นธรรมของการเลือกตั้งและความเชื่อมั่นของสังคมได้ในระยะยาว

ปัญหาการใช้ AI ที่ไม่สุจริตนี้อาจเป็นปัญหาใหม่ของการเลือกตั้งในยุคดิจิทัล ทำให้หน่วยงานรัฐต้องกำกับดูแลด้วยแนวทางที่ครอบคลุมและบูรณาการ โดยสามารถเริ่มต้นจากมาตรการทางกฎหมายที่เป็นการกำกับดูแลจากภาครัฐ ควบคู่การสร้างความร่วมมือจากภาคเอกชน ภาคประชาสังคมและสื่อมวลชน เพื่อให้มั่นใจว่าประชาชนจะสามารถลงคะแนนเสียงบนพื้นฐานของข้อเท็จจริง ไม่ใช่สิ่งที่ถูกสร้างขึ้นด้วย AI

อ้างอิง

- บทความ AI & electionsAI & elections โดย Australian Electoral Commission (AEC)

- บทความThe use of AI in electoral campaigns: key issues and remedies โดย MediaLaws

- บทความสรุปร่างกฎหมาย Artificial Intelligence (AI) in Elections and Campaigns โดย NCSL

- บทความเสนอพรรคการเมือง ลงนาม ‘Code of conduct’ ใช้ AI ในการเลือกตั้งอย่างรับผิดชอบ โดยสมาคมนักข่าวนักหนังสือพิมพ์แห่งประเทศไทย

- ระเบียบคณะกรรมการการเลือกตั้งว่าด้วยวิธีการหาเสียงและลักษณะต้องห้ามในการหาเสียงเลือกตั้งสมาชิกสภาผู้แทนราษฎร

- บันทึกการประชุมคณะกรรมาธิการการพัฒนาการเมือง การสื่อสารมวลชน และการมีส่วนร่วมของประชาชนสภาผู้แทนราษฎรครั้งที่ ๘๗ วันพุธที่ ๒๒ ตุลาคม ๒๕๖๘

- คลิปวิดีโอยูทูป You Won’t Believe What Obama Says In This Video! 😉 โดย BuzzFeedVideo

- บทความข่าว Trump supporters target black voters with faked AI images โดย BBC

- บทความข่าว【謠言風向球】賴清德說藍白合是對的組合? AI變造影片現身台灣總統選戰 โดย Taiwan Factcheck Center